La inteligencia artificial ha transformado nuestro día a día, desde cómo y donde trabajamos hasta con quienes nos comunicamos. Una de las formas en las que esta siendo utilizada esta tecnología es en el fraude telefónico: la irrupción de esta tecnología y su rápido desarrollo en los últimos años ha posibilitado que las las estafas telefónicas sean mas sofisticadas. Y no solo eso, herramientas gratuiras como Vocloner están democratizando las ciberestafas.

Una de las técnicas maliciosas que más se han visto reforzadas ha sido el vishing, una técnica de ingeniería social para obtener información confidencial de las víctimas, gracias a la sencillo que es hoy día clonar voces y falsificar los identificadores de llamada.

Esto ocasiona que las víctimas reciban falsas llamadas que parecen provenir de personas de su confianza, como familiares, jefes, socios con voces indistinguibles de las reales. Pero más allá del impacto económico, el impacto emocional de recibir una llamada de emergencia o una solicitud urgente de alguien cuya voz reconocemos pueden ser muy graves, llevando a muchas víctimas a actuar precipitadamente, cediendo datos o información clasificada que puede no solo afectarles a ellos si no también a sus organizaciones y seres queridos.

En este artículo explicamos cómo funciona exactamente este tipo de ataque y qué técnicas emplean los delincuentes para hacerlas tan efectivas.

Qué es el spoofing y que tipos existen

El spoofing es una técnica de suplantación de identidad que permite a ciberdelincuentes hacerse pasar por otra persona o entidad. Existen diferentes tipos de spoofing, cada uno aprovechando distintos canales de comunicación, como por ejemplo el email spoofing, que consiste en enviar correos electrónicos falsificando la dirección del remitente para hacer creer al destinatario que los correos provienen de una fuente legítima o el SMS spoofing, que implica falsificaciones del número del remitente en mensajes de texto, creando la ilusión de que provienen de una fuente confiable, como un banco o una agencia gubernamental.

Luego está el caller ID spoofing o «call spoofing», que consiste en manipular el identificador de llamada para mostrar un número falso en la pantalla de la víctima. El peligro de estas tácticas son que el receptor realmente confíe en que el mensaje proviene del remitente, debido a que generalmente utilizan ingeniería social induciendo al receptor a realizar acciones inmediatas, generalmente relacionadas con pagos o la cesión de datos privados.

Cabe aclarar que a diferencia del vishing, el spoofing es solo un medio para enmascarar la llamada, no necesariamente implica un intento de fraude por voz, aunque suele usarse como paso previo en ataques vishing.

Voice Phising y el rol de la IA en la clonación de voz

El vishing es un tipo de fraude telefónico en el que los atacantes se hacen pasar por entidades legítimas como bancos, servicios técnicos o incluso familiares, utilizando técnicas como el caller ID spoofing para manipular el número que aparece en la pantalla de la víctima. Estos estafadores aprovechan el impacto emocional de la voz humana, creando sensación de urgencia o emergencia para engañar a sus objetivos.

La IA ha revolucionado el fraude vocal al hacer posible replicar cualquier voz con solo unos segundos de audio obtenido de redes sociales, mensajes de voz o llamadas anteriores. Herramientas como Eleven Labs, Resemble.AI o iSpeech analizan patrones de habla, tono y emociones para generar réplicas casi indistinguibles del original, un proceso que ahora toma minutos en lugar de requerir equipos profesionales y horas de edición. Sin embargo, su mal uso por parte de ciberdelincuentes ha elevado el vishing a un nuevo nivel de peligrosidad, ya que los estafadores pueden imitar voces conocidas para generar confianza inmediata.

Este avance tecnológico ya ha demostrado su potencial destructivo en casos reales. En 2023, en Emiratos Árabes Unidos, un grupo de delincuentes utilizó voz clonada con IA para suplantar a un ejecutivo bancario y estafar más de 35 millones de dólares en una operación cuidadosamente planeada. Este y otros casos similares ilustran cómo la combinación de ingeniería social y herramientas de IA ha convertido al vishing en una amenaza cada vez más difícil de detectar.

Clonando una voz

El proceso de clonación de voz con fines fraudulentos sigue una metodología precisa: en primer lugar, el atacante recopila muestras de audio de la víctima, obtenidas de fuentes públicas como redes sociales, mensajes de voz o llamadas grabadas.

Posteriormente, utiliza herramientas de inteligencia artificial especializadas para entrenar un modelo de voz con esos audios, permitiendo al sistema aprender y replicar las características vocales únicas del objetivo. Una vez entrenado el modelo, la IA puede generar voz sintética capaz de pronunciar cualquier frase con un alto grado de realismo.

Este audio clonado se integra entonces en operaciones de vishing, combinado frecuentemente con técnicas de caller ID spoofing para aumentar la credibilidad del engaño.

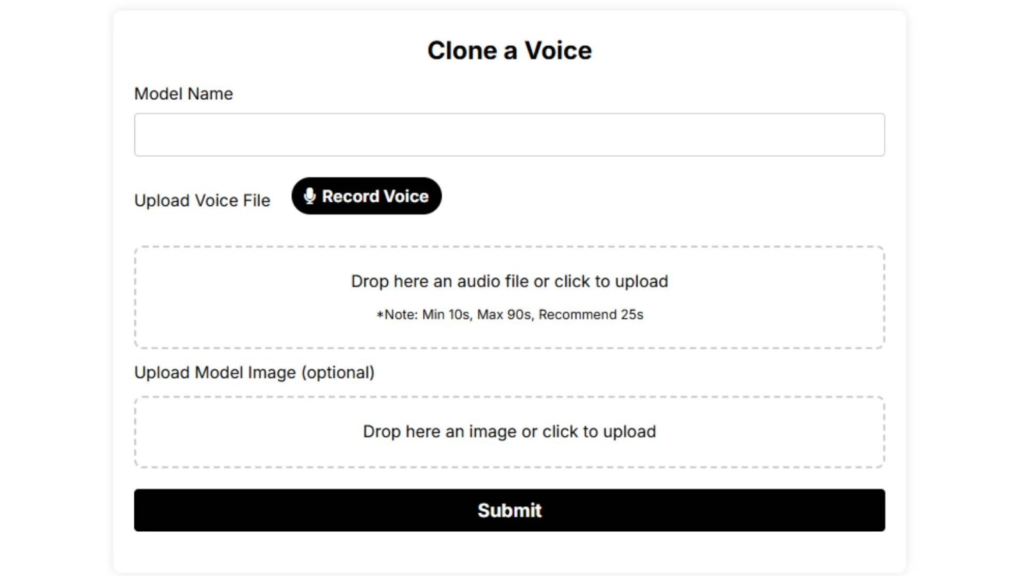

A modo ilustrativo, se podría utilizar como ejemplo la voz característica de Mariano Rajoy, expresidente del Gobierno español, cuya peculiar cadencia y tono la hacen especialmente reconocible. Mediante un video público como referencia, cuya pista de audio puede extraerse en formato MP3, y utilizando plataformas de clonación vocal como Vocloner -entre otras alternativas como ElevenLabs, Sesame o MangioRVC- se demuestra cómo incluso voces fácilmente identificables pueden replicarse con notable precisión.

Recordamos que este ejercicio ha sido diseñado con fines meramente demostrativos y utilizando herramientas gratuitas. Pulsamos clonar voz, lo nombramos y subimos el archivo mp3 del video que hemos descargado con la voz original. Una vez se carga y se sube todo, nos llevara a la siguiente pantalla donde tenemos que poner el texto que queremos que diga y generamos el «speech». El resultado es el siguiente audio:

Cadena de ataque

El vishing potenciado por IA sigue un proceso metódico: el atacante selecciona a su víctima (personas mayores o con exposición en redes), obtiene muestras de voz desde grabaciones públicas o llamadas engañosas, clona la voz con herramientas de IA y suplanta el número de llamada para generar confianza; luego, mediante una llamada emotiva que simula emergencias (accidentes, secuestros o supuestas deudas), manipula a la víctima para que realice acciones inmediatas como transferencias, compartir códigos o instalar malware, aprovechando la urgencia y el realismo de la voz clonada.

En Los Ángeles, un hombre fue víctima de una estafa en la que los delincuentes utilizaron IA para replicar la voz de su hijo, solicitándole 25.000 dólares bajo la falsa premisa de un accidente grave, mientras que en Segovia, estafadores clonaron la voz del obispo Mons. Jesús Vidal para pedir 2.200 euros a sacerdotes alegando una herencia para la diócesis, aunque uno de ellos logró detectar el engaño.

Estos casos reflejan el impacto global de este tipo de fraudes, ya que, según la Comisión Federal de Comercio de EE.UU., en 2023, las pérdidas por estafas telefónicas alcanzaron los 2.700 millones de dólares, y una encuesta en el Reino Unido reveló que más del 25% de los adultos había sido víctima de clonación de voz mediante IA, con un 46% desconociendo incluso su existencia.

Como protegerse

Para protegerse, es crucial verificar la llamada por otro canal: cuelga y contacta al número real de la persona por móvil o usa WhatsApp, SMS o correo para confirmar. También ayuda establecer códigos familiares de emergencia, como una palabra clave que solo conozcan allegados, además de educar a los más mayores, ya que son el target frecuentes.

Además, se debe evitar responder llamadas de desconocidas: si es importante, el remitente dejará un mensaje o le contactará por otra vía. Finalmente, limitar la información personal en redes sociales previene que estafadores obtengan datos para ataques más convincentes.